KVKK TEKNİK TEDBİRLERİNE UYUM VE UYUM SÜRECİNDE YAPAY ZEKA KULLANIMI

Hamza Aytaç DOĞANAYa, Hakan ALTAYb

a Öğretim Görevlisi, Ankara Üniversitesi, ORCID: 0000-0003-4816-4373, e-Posta: hdoganay@ankara.edu.tr

b Firma Kurucu Ortağı, TRSiBER Bilişim ve Danışmanlık A.Ş., e-Posta: hakan.altay@trsiber.com.tr

ÖZET

Yapay zeka (YZ) teknolojilerinin insan hayatının her alanına hızla nüfuz etmesi, hukuk sistemlerini ve veri güvenliği paradigmalarını hazırlıksız yakalamış, teknolojik gelişim ile yasal düzenlemeler arasında ciddi bir boşluk oluşmasına neden olmuştur. Bu çalışma, yapay zekanın kişisel verilerin korunması alanında yarattığı tehditleri ve sunduğu fırsatları, Türkiye’nin mevcut hukuki durumu ve küresel literatür ışığında incelemektedir. Çalışmada, YZ’nin siber saldırı aracı olarak kullanılmasıyla ortaya çıkan “Yapay Zeka vs. Yapay Zeka” mücadelesine 6698 sayılı Kişisel Verilerin Korunması Kanunu (KVKK) kapsamında teknik tedbirlerin uygulanmasında göz önünde bulundurulması gereken bir husus olarak değinilmiş; Avrupa Birliği, Çin ve ABD eksenli güncel araştırmalar üzerinden literatür çalışması gerçekleştirilmiştir. Araştırmanın odak noktasını, KVKK kapsamında veri sorumlularının alması gereken teknik tedbirlerin uygulanabilirliği hususunda YZ’nin uyumu oluşturmaktadır. Büyük veri (Big Data) ortamlarında yetki matrislerinin yönetimi, erişim loglarının analizi, anomali tespiti ve veri kaybı önleme (DLP) gibi kritik süreçlerin, geleneksel yöntemlerle yönetilmesinin imkansız hale geldiği; bu nedenle YZ destekli teknik tedbir otomasyonun bir tercih değil, zorunluluk olduğu vurgulanmıştır. Çalışma dolaylı olarak, yapay zekanın veri gizliliği için hem bir risk kaynağı hem de en güçlü savunma mekanizması olduğu paradoksunu da gün yüzüne çıkarmaktadır.

Anahtar Kelimeler: Yapay Zeka, Kişisel Verilerin Korunması, KVKK, Teknik Tedbirler, Siber Güvenlik, Veri Gizliliği.

GİRİŞ

Yapay zeka (YZ) her aşamasıyla insan hayatının her yönüne hızla entegre olmaya devam ederken birçok ülkede henüz hukuki düzenleme yapılmamıştır. Henüz yapay zekanın adli süreçte fail, mağdur veya araç olarak hangi rolde olabileceği meçhul vasfını korumaktadır. Türkiye de henüz somut bir hukuki düzenleme yapamamış ülkeler arasındadır. Bu durum yapay zekanın ivmesinden kaynaklanmaktadır ve yasa koyucu henüz gelişmeleri izleme aşamasındadır. Bununla birlikte hayatın gerçekliği olarak davalara konu olmaya başlayan yapay zeka hakkında mahkeme kararları da verilmeye başlanmıştır. Bu noktada karşımıza veri gizliliği, kişisel verilerin korunması ve bu çerçevede yapay zekanın kullanımı da önemli bir nokta olarak karşımıza çıkmaktadır. Yapay zekanın kurum ve kuruluşlardaki entegrasyonu ve insanlar arasındaki kullanım çeşitliliği veri gizliliği ile doğrudan alakalıdır.

Diğer yandan kullanım ve önemi artan ve devasa bir kişisel veri kaynağını eğitiminde kullanan yapay zekalar siber saldırganların iştahını kabarttığı gibi bu saldırganlara karşı etkili bir silah olarak kullanıldıkları birçok sistem geliştirilmeye devam etmektedir. Bu siber saldırı türlerinde yapay zeka saldırı aracı olarak kullanıldığı gibi savunma aracı olarak da kullanılmaktadır. Bu açıdan YZ vs YZ mücadelesini siber istihbaratta olduğu gibi siber saldırı, siber savunma ve siber istihbarata karşı koyma alanlarında da sıkça görmeye devam edeceğiz. Bu gelişmeler çerçevesinde özellikle kişisel verilerin korunmasında teknik tedbirlerin alınması görevini yapay zekanın yürütmesinin avantajları olacağı gibi dezavantajlarının da irdelenip prosedürlerin ve uygulamaların sıkılaştırılması ve iyileştirilmesi sağlanmalıdır. Bu amaçla çalışmada yapay zeka ve kişisel verir arasındaki ilişki kapsamında literatür taraması yapılmış ve Kişisel Verileri Koruma Kanunu (KVKK) teknik tedbirlerine uyum ve uyum sürecinde yapay zeka kullanımındaki avantaj ve dezavantajlar irdelenmiştir.

LİTERATÜR

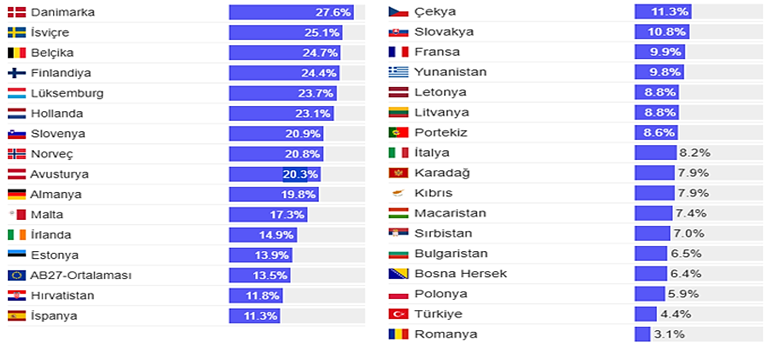

Avrupa Birliği (AB) İstatistik Otoritesi olan Eurostat’ın verilerine göre AB ülkelerinde 16-74 yaş aralığındaki insanların % 32.7’si 2025 yılında üretken YZ (generative AI) kullanmışlardır (Eurostat, 2025). Aynı kuruluş en az 10 çalışanlı 150.000’den fazla firma ile anket çalışması yapmış ve ülkelerin YZ entegrasyonunu araştırmışlar ve Şekil 1’deki sonuçları elde etmişlerdir (Eurostat, 2024). Eurostat’ın başka bir 2025 çalışmasına göre 2023 yılına göre 2024 yılında kuruluşlarındaki YZ entegrasyonu düşen tek ülke 32 ülke arasında Türkiye iken, 2025 yılında 2024 yılına göre Türkiye’nin entegrasyon oranını artırması umut verici ve sevindirici bir gelişme olarak tarafımızdan kayda geçmiştir (Eurostat, 2025).

Şekil 1

AB Ülkelerinde 16-74 Yaş Aralığı Üretken Yapay Zeka Kullanım Oranı

Türkiye’nin Mart 2025’te kabul ettiği 2030 Sanayi ve Teknoloji Stratejisi yapay zekâ (YZ) kapasitesini geliştirmeyi ve YZ uygulamalarını yaygınlaştırmayı birincil öncelik olarak belirlediği 04/11/2025 tarihli Avrupa Komisyonu “Türkiye 2025 Raporu”nda yer bulmuştur (Avrupa Komisyonu, 2025). Türkiye bu sayede hizmetlerin daha geniş çaplı dijitalleşmesine katkı sağlamayı ve bu hedefleri Avrupa Birliği’nin (AB) Dijital On Yıl amaçlarıyla uyumlu hale getirmeyi amaçlamıştır. Bu Strateji, Türkiye ekonomisinin dijital dönüşümünü yönlendirirken, aynı zamanda AB mevzuatına (Acquis) uyum için gereken politika temelini oluşturmaktadır; bu bağlamda, henüz somut bir yasal düzenlemesi bulunmayan Türkiye’nin özellikle AB’nin Yapay Zekâ Yasası’na (AI Act) tam olarak uyum sağlaması ve bu yasanın gerektirdiği denetim ve uygulama yapısını kurması gerektiği vurgulanmaktadır. Aynı çalışmada siber güvenlik ve dijital güven bağlamında Avrupa Birliği Üye Devletleri için elektronik kimlik ve güven hizmetlerini düzenleyen 910/2014 sayılı AB yönetmeliği olan eiDAS’a (“Elektronik Kimlik, Kimlik Doğrulama ve Güven Hizmetleri”) uyumun beklemede olduğu vurgulanmıştır.

Bir çalışmada araştırmacılar yapay zekanın (YZ) kurumsal yönetim ve sermaye yatırımı kararlarındaki uygulamasını, özellikle Avrupa Birliği, Çin ve ABD’deki vaka çalışmaları üzerinden incelemektedir (Xu vd., 2025). Çalışmada, diferansiyel gizlilik (differential privacy) ve federe öğrenme (federated learning) gibi gelişmiş gizlilik koruma teknolojilerinin uygulanmasının, veri ihlallerinde %64’lük bir azalma ve düzenleyici cezalarda %12’lik bir düşüş sağladığı belirtilmiştir. Paydaş geri bildirimleri, bu teknik tedbirlerin denetim hazırlığını %89 ve genel güveni %84 oranında artırdığını göstermiş, ancak hesaplama maliyetleri ve sistem uyumluluğu gibi zorlukların devam ettiği vurgulanmıştır. Araştırma, YZ destekli kurumsal ortamlarda verileri etkili bir şekilde korumak için sağlam teknik çözümlerin örgütsel ve düzenleyici stratejilerle birleştirildiği entegre bir gizlilik yönetimi çerçevesinin benimsenmesinin önemini ortaya koymaktadır. Ayrıca çalışma, GDPR’nin “unutulma hakkı” ve “veri taşınabilirliği” gibi ilkelerinin, YZ sistemlerinin kişisel verileri izleyip kaldırabilecek şekilde tasarlanmasını zorunlu kıldığını hatırlatmaktadır.

Diğer bir araştırma makalesi, güvenilir yapay zekanın temel direkleri olan güvenlik, gizlilik ve sağlamlık kavramlarını kapsamlı bir şekilde ele almaktadır (Saeed ve Asharidah, 2024). Çalışmada, kullanıcı verilerini korumak için şifreleme, anonimleştirme ve erişim kontrolü gibi gizlilik koruma teknolojilerinin uygulanmasının, hassas bilgilerin gizli tutulmasını sağladığı belirtilmektedir. Federe öğrenme (federated learning), verilerin merkezi bir sunucuya taşınmadan işbirlikçi model eğitimine olanak tanıması ve güvenlik ile gizlilik arasındaki karmaşık etkileşimi yönetmesi açısından detaylandırılmıştır. Ayrıca, yapay zeka modellerine yönelik düşmanca saldırılar (adversarial attacks) ve veri zehirlenmesi (data poisoning) gibi tehditlere karşı modelin sağlamlığını artıracak teknikler ve diferansiyel gizliliğin uygulanması tartışılmıştır. Çalışma, güvenilir bir YZ sistemi geliştirmenin, modelin önyargısız olmasını sağlamayı ve “kara kutu” (black box) kararlarının açıklanabilirliğini artırmayı gerektirdiğini vurgulamaktadır.

Makine öğrenimi (ML) yapay zekanın yapı taşlarındandır ve ML sistemlerinde veri gizliliğini korumak için kullanılan Gizlilik Artırıcı Teknolojileri (PETs) ve bunların veri sahipleri açısından önemini sistematik olarak tartışan çalışmalar mevcuttur (El Mestari vd., 2024). Yazarlar, homomorfik şifreleme (homomorphic encryption), güvenli çok taraflı hesaplama (secure multiparty computation) ve diferansiyel gizlilik gibi tekniklerin, veri gizliliğini sağlamada kritik araçlar olduğunu ancak kullanıma hazır (off-the-shelf) uygulamaların tek başına yeterli olmayabileceğini belirtmektedir. Çalışma, ML hattının (pipeline) veri ön işleme, model oluşturma ve model sunumu aşamalarında ortaya çıkan üyelik çıkarımı saldırıları (membership inference attacks) ve model tersine çevirme saldırıları (model inversion attacks) gibi spesifik tehditleri analiz etmektedir. Veri sahiplerinin bakış açısını merkeze alan bu araştırma, teknik tedbirlerin veri işleme aşamasına, ilgili tarafların rollerine ve sistemin mimarisine (merkezi veya dağıtık) bağlı olarak nasıl değişmesi gerektiğini ortaya koymaktadır. Sonuç olarak, AB veri koruma yönetmeliklerine uyum sağlamak için PET’lerin risk temelli bir yaklaşımla ve doğru konfigürasyonlarla entegre edilmesi gerektiği savunulmaktadır.

Reka vd. (2024), akıllı şebekelerde (smart grid) talep yanıtı modellemesi için kullanılan büyük veri analitiği ve yapay zeka yaklaşımlarının gizlilik ve güvenlik endişelerini ele aldığı bir çalışma ortaya koymuşlardır. Çalışma, akıllı sayaçlar ve IoT cihazlarından toplanan büyük miktardaki verinin, siber fiziksel sistemlerde veri ihlalleri, yetkisiz erişim ve veri bütünlüğü saldırıları gibi ciddi tehditler oluşturabileceğini vurgulamaktadır. Makine öğrenimi algoritmalarının, özellikle anomali tespiti ve izinsiz giriş tespiti (intrusion detection) gibi güvenlik çözümlerinde nasıl kullanıldığı ve bu modellerin kendilerinin de siber saldırılara karşı nasıl korunması gerektiği detaylandırılmıştır. Yazarlar, veri yönetimi tehditlerine karşı güvenlik duvarları (firewalls), şifreleme ve makine öğrenimi tabanlı davranışsal analiz gibi teknik tedbirlerin önemine dikkat çekmektedir. Ayrıca, gelecekteki enerji uygulamaları için gerekli olan bu modellerin, hem tüketici gizliliğini koruması hem de şebekenin operasyonel verimliliğini sağlaması gerektiği sonucuna varılmıştır.

Yapay zekanın kullanımında veri gizliliği de özellikle dikkat edilmesi gereken önemli bir husustur. Bu konu ile ilgili bir araştırmada Çin’deki lisans öğrencilerinin ChatGPT gibi yapay zeka dil modellerini kullanırken veri gizliliğine ilişkin algılarını, yansıtıcı günlükler (reflective diaries) aracılığıyla incelenmiştir (Xu vd.,2025). Çalışma, öğrencilerin veri sızıntısı, büyük veri analitiği yoluyla etik olmayan veri kullanımı ve akademik değerlendirmede adaleti zedeleyebilecek algoritmik önyargılar konusunda önemli endişeler taşıdığını ortaya koymaktadır. Bulgular, okullarda uygulanabilir veri yönetişimi, çocuk veri yasalarına (örneğin GDPR, COPPA) uyum, okul-satıcı rollerinin netleştirilmesi ve amaç sınırlaması gibi teknik ve idari tedbirlerin gerekliliğini vurgulamaktadır. Öğrencilerin, verilerinin toplanması ve işlenmesi üzerindeki kontrol eksikliğinden kaynaklanan kaygılarının, YZ teknolojilerine katılımlarını olumsuz etkilediği belirtilmiştir. Sonuç olarak, eğitimde YZ entegrasyonunun sorumlu ve güvenli bir şekilde yapılabilmesi için teknik çözümlerin yanı sıra yaşa uygun bildirimler ve rıza mekanizmalarının da hayata geçirilmesi gerektiği savunulmaktadır.

Metaverse, tahmin edildiği gibi kavram olarak ilk çıktığı zamandaki ününü kaybetmiş olsa da bu mecranın kullanımı ve karmaşık teknolojisinden dolayı veri gizliliği endişeleri halen devam etmektedir. Bahse konu kaygılar kapsamında gerçekleştirilen bir anket çalışması , yapay zeka (YZ) ve genişletilmiş gerçeklik (XR) teknolojilerinin birleşimiyle oluşan metaverse ortamlarındaki gizlilik zorluklarını ve bunlara yönelik teknik çözümleri incelemektedir (Alkaeed vd., 2024). Metaverse’in kişiselleştirilmiş deneyimler sunmak için kullanıcıların biyometrik verileri, konum bilgileri ve etkileşimleri gibi hassas verileri topladığına dikkat çekilen çalışmada, homomorfik şifreleme (HE) ve federe öğrenme (FL) gibi tekniklerin gizliliği korumada nasıl kullanılabileceği analiz edilmiştir. Makale, diferansiyel gizliliğin (differential privacy) veri setlerine gürültü ekleyerek bireysel veri noktalarının tanımlanmasını zorlaştırdığını ve bu sayede kullanıcı gizliliğini korurken büyük veri analizine olanak tanıdığını belirtmektedir. Ayrıca, güvenli çok taraflı hesaplama (SMPC) ve blokzincir tabanlı çözümlerin, verilerin şifresini çözmeden işlenmesini sağlayarak veri sızıntısı risklerini azalttığı ifade edilmiştir. Çalışma, metaverse içerisindeki sensörlerden (göz izleme, hareket sensörleri vb.) kaynaklanan mahremiyet tehditlerine karşı uçta makine öğrenimi (edge ML) gibi donanım tabanlı çözümlerin de önemini vurgulamaktadır.

Akakpo vd. (2025) İletişim Gizliliği Yönetimi (CPM) teorisini kullanarak yapay zeka benimsemesinin gelecekteki gizlilik üzerindeki etkilerini, 42 YZ uzmanıyla yapılan görüşmeler üzerinden çalışmışlardır. Araştırmacılar, YZ’nin “kara kutu” (black box) doğasının yarattığı şeffaflık/opaklık sorununun ve verilerin izinsiz kullanımının (data abuse), geleneksel gizlilik sahipliği kavramlarını zorlayacağını öne sürmektedir. Çalışmada, “bilginin silah haline getirilmesi” (information weaponization) temasının altı çizilerek, teknik tedbirlerin sadece veriyi korumakla kalmayıp, aynı zamanda verinin bireylere karşı şantaj veya manipülasyon aracı olarak kullanılmasını engelleyecek şekilde tasarlanması gerektiği belirtilmiştir. Bulgular, YZ teknolojilerinin ilerlemesiyle birlikte bireylerin gizlilik üzerindeki kontrollerini kaybedebileceği endişesini doğrulamakta ve veri minimizasyonu gibi teknik ilkelerin uygulanmasının önemini vurgulamaktadır. Yazarlar, gelecekte gizlilik haklarının korunması ile YZ’nin faydaları arasında bir denge kurabilmek için hem teknik hem de yasal çerçevelerin yeniden yapılandırılması gerektiğini savunmaktadır.

ChatGPT gibi üretken yapay zeka (Generative AI) sistemlerinin eğitim verileri ve çalışma prensiplerinden yola çıkarak, bu teknolojilerin yarattığı veri sızıntısı ve kişisel veri risklerini Çin hukuku perspektifinden inceleyen araştırmacılar çalışmalarında üretken YZ’nin eğitim aşamasında kullanılan verilerin kimliksizleştirilmesi (de-identification) ve veri güvenliği risklerinin yönetilmesi için gizlilik hesaplama teknolojilerinin (privacy computing technologies) gerekliliğini vurgulamaktadırlar (Ye vd., 2024). Mevcut yasal sistemin, özellikle bireysel kontrole dayalı veri koruma rejiminin, üretken YZ’nin veri işleme modları için yetersiz kaldığı ve bu nedenle “güvenilir YZ” hedefine ulaşmak için kurumsal inovasyon gerektiği belirtilmiştir. Yazarlar, veri sızıntısı risklerinin, modelin eğitimi sırasında kullanılan açık kaynaklı bileşenlerdeki güvenlik açıklarından kaynaklanabileceğini ve bu durumun sistemsel sorunlara yol açabileceğini ifade etmektedi. Sonuç olarak, Çin’deki veri koruma uygulamalarının makro-mikro ve özel-kamu hukuku entegrasyonuyla geliştirilmesi gerektiği savunulmaktadır.

Yapay zekanın veri gizliliği üzerindeki etkilerini araştıran başka bir çalışma, yapay zeka teknolojilerini bir ekosistem perspektifiyle ele almakta ve YZ’yi “süreç odaklı” (veri toplama/işleme) ve “sonuç odaklı” (çıktı/karar) olmak üzere bir süreklilik içinde sınıflandırarak gizlilik üzerindeki etkilerini incelemektedir (Martin ve Zimmermann, 2024). Çalışma, YZ’nin büyük hacimli kişisel verilere dayanmasının, bireylerin gizlilik hesaplamalarını (privacy calculus) ve psikolojik sahiplenme (psychological ownership) duygularını nasıl etkilediğini analiz etmektedir. Teknik açıdan, veri toplama aşamasında sensörler ve dijital ayak izleri yoluyla elde edilen verilerin işlenmesi sırasında ortaya çıkan “görünmez” veri akışlarının, bireylerin risk algısını zorlaştırdığı belirtilmektedir. Yazarlar, YZ’nin veri işleme yeteneklerinin, verilerin anonimleştirilse bile yeniden kimliklendirilmesine (re-identification) olanak tanıyan gelişmiş çıkarımlar yapabilmesi nedeniyle yeni teknik koruma yöntemlerine ihtiyaç duyulduğunu vurgulamaktadır. Makale, etik ve sürdürülebilir bir toplum için gizlilik karar alma süreçlerinin hem psikolojik hem de teknik boyutlarının birlikte ele alınması gerektiğini sonucuna varmaktadır.

KVKK TEKNİK TEDBİRLER ve YZ UYUMU

24.03.2016 tarihinde kabul edilen ve 7.4.2016 tarihli 29677 sayılı Resmî Gazetede yayınlanarak yürürlüğe giren 6698 sayılı Kişisel Verilerin Korunması Kanunu ile kişisel verilerin işlenmesinde başta özel hayatın gizliliği olmak üzere kişilerin temel hak ve özgürlüklerini korumak ve kişisel verileri işleyen gerçek ve tüzel kişilerin yükümlülükleri ile uyacakları usul ve esasları düzenlenmiştir. İlgi kanun hükümleri gereği; kişisel verileri işlenen gerçek kişiler ile bu verileri tamamen veya kısmen otomatik olan ya da herhangi bir veri kayıt sisteminin parçası olmak kaydıyla otomatik olmayan yollarla işleyen gerçek ve tüzel kişiler gerek idari gerek teknik tedbirleri alarak kanuna uyumluluk yolunda uyum süreçlerini belirlemiş ve uygulamaya başlamışlardır. Anılan kanun kapsamında kurulan Kişisel Verileri Koruma Kurumu, yayımladığı Kişisel Veri Güvenliği Rehberi ile kişisel verilerin hukuka aykırı olarak işlenmesini ve kişisel verilere hukuka aykırı olarak erişilmesini önlemek ile kişisel verilerin muhafazasını sağlamak amacıyla veri sorumlularının alması gereken teknik ve idari tedbirlere ilişkin başlıca yöntemleri duyurmuştur. Bu rehbere göre alınması gereken İdari ve Teknik Tedbirler Tablo 1 ve Tablo 2’de sunulmuştur.

Tablo 1

KVKK Teknik Tedbirler

| SN. | TEKNİK TEDBİR | SN. | TEKNİK TEDBİR |

| 1. | Yetki Matrisi | 10. | Log Kayıtları |

| 2. | Yetki Kontrol | 11. | Veri Maskeleme |

| 3. | Erişim Logları | 12. | Veri Kaybı Önleme Yazılımları |

| 4. | Kullanıcı Hesap Yönetimi | 13. | Yedekleme |

| 5. | Ağ Güvenliği | 14. | Güvenlik Duvarları |

| 6. | Uygulama Güvenliği | 15. | Güncel Anti-Virüs Sistemleri |

| 7. | Şifreleme | 16. | Silme, Yok Etme veya Anonim Hale Getirme |

| 8. | Sızma Testi | 17. | Anahtar Yönetimi |

| 9. | Saldırı Tespit ve Önleme Sistemleri |

Tablo 2

İdari Tedbirler

| SN. | İDARİ TEDBİR | SN. | İDARİ TEDBİR |

| 1. | Kişisel Veri İşleme Envanteri Hazırlanması | 6. | Risk Analizleri |

| 2. | Kurumsal Politikalar (Erişim, Bilgi Güvenliği, Kullanım, Saklama ve İmha vb.) | 7. | İş Sözleşmesi, Disiplin Yönetmeliği (Kanuna Uygun Hükümler İlave Edilmesi) |

| 3. | Sözleşmeler (Veri Sorumlusu – Veri Sorumlusu, Veri Sorumlusu – Veri İşleyen Arasında ) | 8. | Kurumsal İletişim (Kriz Yönetimi, Kurul ve İlgili Kişiyi Bilgilendirme Süreçleri, İtibar Yönetimi vb.) |

| 4. | Gizlilik Taahhütnameleri | 9. | Eğitim ve Farkındalık Faaliyetleri (Bilgi Güvenliği ve Kanun) |

| 5. | Kurum İçi Periyodik ve/veya Rastgele Denetimler | 10. | Veri Sorumluları Sicil Bilgi Sistemine (VERBİS) Bildirim |

Teknik tedbirlerin alınması ve uygulanması aşamasında teknolojik gelişmelerle birlikte yapay zekâ, KVKK uyumluluk süreçlerinde kurumlara hem hız hem doğruluk hem de otomasyon yeteneği kazandırarak önemli bir araç haline gelmiştir. Bu tedbirler kişisel verilerin korunmasına yönelik olsa da ticari verilerin (üretim, satış, know-how, patent vb) güvenliği, modern kurumlar için kritik bir ihtiyaç hâline gelmiştir. KVKK uyum süreçleri yalnızca dokümantasyon hazırlamakla değil; veri sınıflandırma, log analizi, erişim yönetimi, saldırı tespiti, yedekleme yönetimi gibi çok boyutlu teknik çalışmalarla yürütülmektedir. Fakat kullanıcı davranışlarındaki farklılık, sistemlerdeki veri hacimlerinin artarak büyümesi (big data), üretilen iz kayıtlarının (log) milyonlar seviyesine çıkması ve saldırganların sürekli yenilenen ve gelişen saldırı vektörlerini kullanmaları nedeniyle teknik tedbirlerde yapay zekâ desteği sürdürülebilir uyum için zorunlu hale gelmiştir.

Yetki Matrisi, Kurum çalışanlarının görevlerine göre hangi veri ve sistemlere hangi yetkilerle erişim sağlayacağını belirten bir yapıdır. Yapay zeka ile erişim yetkisi dışında kalan sistem ve verilere (kişisel veriler dahil) erişim teşebbüsünde bulunması yapay zeka tarafından bir anomali olarak algılanacak ve uyarı mekanizması devreye girecektir. Yetki Matrisinin bir tabloda tutulması roller arasındaki gereksiz tanımlamaların fark edilmesini zorlaştıracağından bu tablonun yapay zeka ile rol benzerlik analizlerinin yapılması daha sağlıklı olacaktır.

Oluşturulan Yetki Matrisinin organizasyondaki görev değişikliklerini de düşünerek sürekli gözden geçirilmesi gereklidir. Yapay zeka ile uzun süre işlem yapmayan hesapların tespiti, bir rolün benzer diğer rollere göre daha fazla yetkiye sahip olması gibi yetki farklılıklarının tespiti de kolay olacaktır.

Erişim iz kayıtlarının üretilmesi, zaman damgası ile bütünlüğünün korunması, yedekliğinin sağlanması genel veri güvenliği için önemli olsa da bu iz kayıtlarının yapay zeka destekli platform üzerinde korelasyonlara tabi tutularak anomali tespitinin yapılması da büyük önem arz etmektedir. Saniyede on binlerce adet üretilen iz kayıtlarının manuel takibi imkansızdır.

Yeni açılacak kullanıcı hesaplarına verilecek aşırı yetkilendirme de yine yapay zeka ile tespit edilebilir ve olağan dışı yetkinin önüne geçilebilir.

Ağ Güvenliği konusunda trafiğin sürekli izlenmesi, davranışsal öğrenme sonucu anormal bir trafiğin anında tespiti ve uyarı mekanizmasının devreye sokulması, trafiğin önlenmesi gibi pek çok konuda yapay zeka desteği kolaylık sağlamaktadır.

Kullanılan yazılımların devreye alınmadan önce ve kullanım aşamasında yapay zeka destekli statik kod analizörleri ile test edilmesi de teknik tedbirin uygulanmasında önem taşıyacaktır.

Verilerin saklanmasında ve iletilmesinde kullanılan iletişim yollarının güvenli olması, bu trafikteki protokollerde bilinen zafiyetlerin tespitinde de yapay zeka destekli zafiyet tarama araçları kullanılmaktadır.

Bilişim altyapılarında her yıl yapılması gereken sızma testleri, kısa sürede binlerce payload çalıştırma kapasitesine sahip yapay zeka destekli araçlar ile mümkün olmaktadır.

Veri tabanında maskelenerek saklanması gereken verilerin tespiti ve maskelenmesi büyük veri barındıran yapılarda yapay zeka ile çok hızlı ve basit uygulanmaktadır.

Teknik tedbirlerden veri kaybı önleme yazılımları (DLP), her türlü kişisel verinin belirlenen kurallar dışında erişilmesini, iletilmesini, kopyalanmasını, yazdırılmasını engellerken en büyük desteği yine yapay zekadan almaktadır. Özellikle verinin parçalanarak çıkartılması gibi yöntemler yapay zeka ile kolayca tespit edilmekte ve önlenmektedir.

Saklama süresi dolmuş veya veri sahibinin talebi üzerine silinmesi gereken verilerin tespiti, veriler üzerindeki hareketler (değişiklik, iletilmesi vb) yapay zeka ile kolaylıkla tespit edilebilmektedir.

KVKK teknik tedbirleri, modern kurumların siber güvenlik altyapısının temelini oluşturur. Artan veri hacimleri, yükselen saldırı türleri ve karmaşık BT altyapıları, yapay zekâ desteği olmadan etkin yönetilemez. Yapay zeka, anomali tespiti, veri sınıflandırma, erişim kontrolü, log analizi, zafiyet yönetimi gibi alanlarda kurumlara hız, doğruluk ve maliyet avantajı sağlar.

Doğru tasarlanan bir Yapay Zeka destekli güvenlik mimarisi, KVKK uyumunu yalnızca kolaylaştırmakla kalmaz; aynı zamanda kurumsal güvenlik seviyesini ciddi şekilde artırır.

SONUÇ

Bu çalışmada, YZ teknolojilerinin kişisel verilerin korunması süreçlerine etkisi, hem literatürdeki güncel tartışmalar hem de KVKK teknik tedbirleri bağlamında kapsamlı bir şekilde ele alınmıştır. Elde edilen bulgular ve yapılan analizler ışığında varılan temel sonuçlar devam eden şekilde özetlenmiştir. İlk olarak, Türkiye’nin 2030 Sanayi ve Teknoloji Stratejisi ile dijitalleşme vizyonunu ortaya koymasına rağmen, yapay zekanın hukuki statüsünü belirleyen somut ve kapsamlı bir yasal düzenlemenin henüz hayata geçirilmediği görülmektedir. Yapay zekanın adli süreçlerdeki rolünün (fail, araç veya ispat aracı) belirsizliği ve Avrupa Birliği’nin “Yapay Zeka Yasası” (AI Act) gibi düzenlemelerine uyum ihtiyacı, Türkiye’de yasa koyucunun ivedilikle harekete geçmesi gerektiğini göstermektedir. Teknolojinin hızı karşısında hukuki boşlukların, kişisel verilerin güvenliğini riske attığı ve denetim mekanizmalarını zayıflattığı açıktır. Bu nedenle, sadece etik ilkelerle sınırlı kalmayan, yaptırım gücü yüksek ve AB müktesebatı ile uyumlu yasal çerçevelerin oluşturulması elzemdir.

İkinci ve en kritik sonuç ise teknik tedbirlerin uygulanmasında yapay zekanın rolü ile ilgilidir. Günümüzde veri hacminin devasa boyutlara ulaşması ve siber tehditlerin karmaşıklaşması, KVKK uyum süreçlerinde insan gücüne dayalı manuel kontrolleri yetersiz kılmaktadır. Çalışmada incelenen yetki matrisi yönetimi, saldırı tespiti, log analizi ve veri maskeleme gibi teknik tedbirlerin etkin bir şekilde uygulanabilmesi için yapay zeka, “vazgeçilmez” bir işlev üstlenmektedir. Özellikle siber saldırganların yapay zekayı bir silah olarak kullandığı bir ekosistemde, savunma tarafında yapay zeka destekli anomali tespiti ve otomatik tepki sistemlerinin kullanılmaması, kurumları savunmasız bırakacaktır.

Sonuç olarak, kişisel verilerin korunması ile yapay zeka arasındaki ilişki, tek yönlü bir tehdit algısından çıkarılarak bütüncül bir yaklaşımla yönetilmelidir. Yasal düzenlemelerle sınırları çizilmiş, etik değerlere saygılı ve teknik olarak yapay zeka ile güçlendirilmiş bir veri güvenliği mimarisi, dijital geleceğin en önemli teminatı olacaktır. Yapay zeka, veri mahremiyeti için bir tehdit potansiyeli taşısa da, bu tehdidi bertaraf edecek teknik tedbirlerin yegâne uygulayıcısı yine yapay zekanın kendisidir.

Yazarlar: Hamza Aytaç DOĞANAYa, Hakan ALTAYb

Kaynakça

Eurosat. (2025). Individuals – use of generative AI tools. https://ec.europa.eu/eurostat/databrowser/view/isoc_ai_iaiu/default/table?lang=en.

Eurostat (2024). Digitalisation in Europe – 2024 edition. https://ec.europa.eu/eurostat/web/interactive-publications/digitalisation-2024#technology-uptake-in-businesses.

Eurostat (2025). Artificial intelligence by size class of enterprise. https://ec.europa.eu/eurostat/databrowser/view/isoc_eb_ai/default/table?lang=en

Avrupa Komisyonu. (2025). Türkiye 2025 Report. https://enlargement.ec.europa.eu/document/download/4bb4ddd1-4f20-4ee0-92db-926996ec8dd1_en?filename=t%C3%BCrkiye-report-2025.pdf.

Xu, M., Zhai, F., & Zhang, T. (2025). Privacy Protection in the Application of Artificial Intelligence Technology in Corporate Governance. International Journal of Information Security and Privacy, 19(1). https://doi.org/10.4018/IJISP.389733

Saeed, M. M., & Alsharidah, M. (2024). Security, privacy, and robustness for trustworthy AI systems: A review. Computers and Electrical Engineering, 119, 109643. https://doi.org/10.1016/j.compeleceng.2024.109643

El Mestari, S. Z., Lenzini, G., & Demirci, H. (2024). Preserving data privacy in machine learning systems. Computers & Security, 137, 103605. https://doi.org/10.1016/j.cose.2023.103605

Reka, S. S., Dragicevic, T., Venugopal, P., Ravi, V., & Rajagopal, M. K. (2024). Big data analytics and artificial intelligence aspects for privacy and security concerns for demand response modelling in smart grid: A futuristic approach. Heliyon, 10, e35683. https://doi.org/10.1016/j.heliyon.2024.e35683

Xu, X., Liu, J., Zheng, R., Lei, V. N.-L., & An, Q. (2025). Learners’ perception of data privacy when using AI language models: Reflective diary analysis of undergraduates in China. Acta Psychologica, 260, 105491. https://doi.org/10.1016/j.actpsy.2025.105491

Alkaeed, M., Qayyum, A., & Qadir, J. (2024). Privacy preservation in Artificial Intelligence and Extended Reality (AI-XR) metaverses: A survey. Journal of Network and Computer Applications, 231, 103989. https://doi.org/10.1016/j.jnca.2024.103989

Akakpo, A., Gyasi, E. A., Oduro, B., & Akpabot, S. (2025). Artificial Intelligence (AI) and the Future of Information Privacy. Journal of Global Information Management, 33(1), 1-29. https://doi.org/10.4018/JGIM.383050

Ye, X., Yan, Y., Li, J., & Jiang, B. (2024). Privacy and personal data risk governance for generative artificial intelligence: A Chinese perspective. Telecommunications Policy, 48, 102851. https://doi.org/10.1016/j.telpol.2024.102851

Martin, K. D., & Zimmermann, J. (2024). Artificial intelligence and its implications for data privacy. Current Opinion in Psychology, 58, 101829. https://doi.org/10.1016/j.copsyc.2024.101829